دستگاههای ذهنخوان میتوانند به دزد افکار ما تبدیل شوند

به گفتهی محققان، دستگاههایی که میتوانند فعالیت مغز را ضبط کنند و تغییر دهند، مشکلاتی مربوط به حریم خصوصی ایجاد میکنند که قوانین موجود حقوق بشر را به چالش میکشد و باید برای کنترل آن قوانینی تنظیم کرد.

به گزارش ایسنا و به نقل از نیچر، پیشرفتهای علمی به سرعت مفاهیم علمی-تخیلی مانند ذهن خوانی را به واقعیت تبدیل میکنند و باعث شکلگیری سوالات چالشبرانگیزی در ذهن اخلاقدانانی میشوند که در حال بررسی چگونگی تنظیم مقررات برای روشهای ذهنخوانی برای محافظت از حقوق بشر مانند حریم خصوصی هستند.

در روز ۱۳ ژوئیه، دانشمندان علوم اعصاب، متخصصان اخلاقشناسی و وزرای دولت این موضوع را در نشست پاریس که توسط یونسکو(آژانس علمی و فرهنگی سازمان ملل متحد) سازماندهی شده بود، مورد بحث قرار دادند.

نمایندگان گامهای بعدی را در اداره چنین «فناوریهای عصبی» یا به عبارت دیگر روشها و دستگاههایی که مستقیما با مغز برای نظارت بر آن یا تغییر فعالیت آن در تعامل هستند، ترسیم کردند.

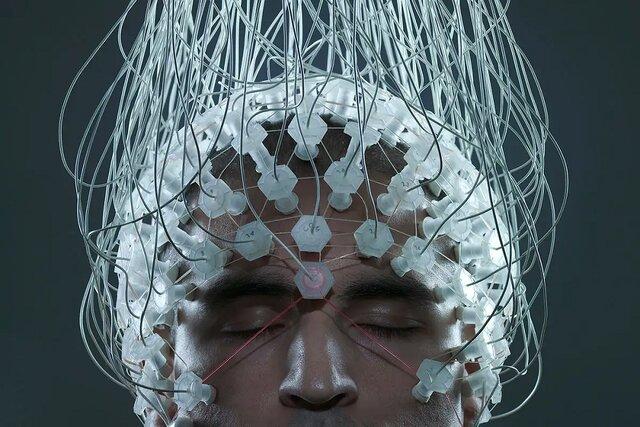

این فناوریها اغلب از روشهای الکتریکی یا تصویربرداری استفاده میکنند و طیف وسیعی را از دستگاههای مورد تایید پزشکی مانند ایمپلنتهای مغزی برای درمان بیماری پارکینسون گرفته تا محصولات تجاری مانند پوشیدنیهای مورد استفاده در واقعیت مجازی(VR) در بر میگیرند. دستگاههایی که برای جمعآوری دادههای مغز استفاده میشوند یا به کاربران اجازه میدهد با ذهن خود نرمافزارها را کنترل کنند.

گابریلا راموس(Gabriela Ramos)، دستیار مدیرکل علوم اجتماعی و انسانی یونسکو، در این نشست گفت که تنظیم مقررات برای نوروتکنولوژی یک بحث فناورانه نیست بلکه یک بحث اجتماعی، یک بحث قانونی است.

پیشرفتها در فناوری عصبی شامل روشهای تصویربرداری عصبی است که میتواند محتوای افکار افراد را رمزگشایی کند، و رابطهای مغز و رایانه(BCIs) کاشتهشده در مغز که میتواند افکار افراد را به متن تبدیل کند.

این حوزه به سرعت در حال رشد است و آخرین گزارش یونسکو در مورد نوروتکنولوژی که در این نشست منتشر شد، نشان داد که در سراسر جهان، تعداد ثبت اختراعهای مرتبط با فناوری عصبی که سالانه ثبت میشوند، بین سالهای ۲۰۱۵ تا ۲۰۲۰ دو برابر شده است. این گزارش میگوید که سرمایهگذاری روی این مورد بین سالهای ۲۰۱۰ تا ۲۰۲۰، ۲۲ برابر شده و نوروتکنولوژی اکنون یک صنعت ۳۳ میلیارد دلاری است.

دستگاهها فراوانند

نیتا فراهانی دانشمند ایرانی آمریکایی و کارشناس اخلاق در دانشگاه دوک در دورهام، کارولینای شمالی، که در این جلسه شرکت داشته است میگوید که بازار انبوه دستگاههای نظارت بر مغز افزودهای قدرتمند به دنیای دیجیتال خواهند بود که در آن شرکتها و بازیگران صحنه سیاسی از دادههای شخصی برای منافع سیاسی یا تجاری استفاده میکنند.

فراهانی میگوید: سیاستگذاران با چالش ایجاد مقرراتی روبرو هستند که از آسیبهای احتمالی فناوریهای عصبی جلوگیری میکند اما تحقیقات در مورد مزایای آنها را محدود نمیکند و محصولات پزشکی و مصرفی چالشهای متمایزی ایجاد میکنند.

محصولاتی که برای استفاده بالینی در نظر گرفته شدهاند عمدتا توسط مقررات موجود برای داروها و دستگاههای پزشکی کنترل میشوند. برای مثال، سیستمی که فعالیت مغزی افراد مبتلا به صرع را نظارت میکند و مغز آنها را برای سرکوب تشنجهای احتمالی تحریک میکند، در مرحله استفاده بالینی است. دستگاههای پیشرفتهتر مانند ایمپلنتهای کاشتهشده در مغز که به افراد فلج اجازه میدهد دستگاههای خارجی مختلف را تنها با استفاده از افکار خود کنترل کنند، در مرحله آزمایشی هستند.

سیاستگذاران با چالش ایجاد مقرراتی روبرو هستند که از آسیبهای احتمالی فناوریهای عصبی جلوگیری میکند اما تحقیقات در مورد مزایای آنها را محدود نمیکند.

اما دستگاههای تجاری برای اخلاقگرایان نگرانکنندهتر هستند. شرکتهایی از استارتآپها گرفته تا غولهای فناوری در حال توسعه دستگاههای پوشیدنی برای استفادههای گستردهای هستند که شامل هدست، هدفون و مچبند میشود که اشکال مختلف فعالیت عصبی را ثبت میکنند و به تولیدکنندگان دستگاهها امکان دسترسی به این اطلاعات را میدهند.

حریم خصوصی این دادهها یک مسئله کلیدی است. رافائل یوست(Rafael Yuste)، عصبشناس دانشگاه کلمبیا در شهر نیویورک در این جلسه گفت که یک تحلیل منتشر نشده توسط بنیاد حقوق عصبی که او یکی از بنیانگذاران آن بود، نشان داد که ۱۸ شرکت ارائه دهنده فناوریهای عصبی دارای شرایط و ضوابطی هستند که کاربران را ملزم میکند که مالکیت دادههای مغز خود را به شرکت بدهند. همه به جز یکی از آن شرکتها، حق اشتراک گذاری آن دادهها را با اشخاص ثالث محفوظ میدارند. یوست میگوید: این نشان دهنده فقدان مقررات است.

فراهانی میگوید: با توجه به اینکه بازار بالقوهی این محصولات، بزرگ است و شرکتها ممکن است به زودی به دنبال سود بردن از دادههای عصبی مردم باشند، تنظیم مقررات برای دستگاههای تجاری ضروری است.

نیاز به تهیه حقوق عصبی

موضوع دیگر این نشست این بود که چگونه توانایی ثبت و دستکاری فعالیتهای عصبی، حقوق بشر را به چالش میکشد. برخی از سخنرانان استدلال کردند که مواردی که در حقوق بشر کنونی لحاظ شده مانند حق حفظ حریم خصوصی این نوآوری را پوشش میدهد، در حالی که دیگران فکر میکنند نیاز به تغییرات وجود دارد.

دو محقق، ایدهی «حقوق عصبی» را مورد بحث قرار دادند. حقوقی که از اشخاص در برابر شخص ثالث که میتواند به فعالیت عصبی فرد دسترسی داشته باشد و بر آن تأثیر بگذارد، محافظت میکنند.

مارسلو اینکا(Marcello Ienca)، فیلسوف دانشگاه فنی مونیخ آلمان، در این نشست گفت: حقوق عصبی میتواند هم آزادی منفی و هم آزادی مثبت به همراه باشد. برای مثال، آزادی منفی به معنای رهایی از نفوذ اطلاعات مغز شما بدون رضایت است. یک آزادی مثبت ممکن است توانایی افراد برای دسترسی عادلانه به یک فناوری پزشکی ارزشمند باشد.

یوست و همکارانش پنج حق عصبی اصلی را پیشنهاد میکنند:

- حق حفظ حریم خصوصی ذهنی

- محافظت در برابر دستکاریهای تغییر شخصیت

- حفاظت از اراده آزاد و تصمیم گیری

- دسترسی منصفانه به تقویت ذهنی

- و محافظت در برابر سوگیریها در الگوریتمهایی که در مرکز فناوری عصبی هستند

یوست و اینکا امیدوارند که پیشنهادات آنها به بحث در مورد مقررات مربوط به خواندن مغز و چالشهای حقوق بشر کمک کند.

تغییر واقعی

کشورهایی از جمله شیلی، اسپانیا، اسلوونی و عربستان سعودی تدوین مقررات را آغاز کردهاند و نمایندگان در این نشست درباره کار کشورهای خود بحث کردند. شیلی در سال ۲۰۲۱ اولین کشوری بود که قانون اساسی خود را به روز و اذعان کرد که فناوری عصبی نیاز به نظارت قانونی دارد.

کارولینا گینزا کورتس(Carolina Gainza Cortés)، معاون وزیر علوم و فناوری شیلی، گفت که در حال تدوین قوانین جدید است و قانونگذاران در حال بحث در مورد چگونگی حفظ حقوق بشر و در عین حال فراهم کردن امکان تحقیق در مورد مزایای این فناوریها هستند.

گام بعدی برای کشورهای عضو یونسکو این خواهد بود که در ماه نوامبر در مورد اینکه آیا این سازمان باید دستورالعملهای جهانی در زمینهی فناوری عصبی تولید کند یا خیر رای بدهند. این مشابه دستورالعملهایی است که یونسکو برای هوش مصنوعی ارائه میکند و به کشورهای عضو در اجرای قوانین کمک میکند.

فراهانی میگوید: امید من این است که از اصول اخلاقی به چارچوبهای ملموس و قانونی برسیم.

فراهانی در این نشست گفت: در مورد نوروتکنولوژی، خیلی دیر نشده است. این فناوری هنوز در سطح جامعه گسترش نیافته است.

انتهای پیام

منبع خبر: ایسنا ![]()

اخبار مرتبط: دستگاههای ذهنخوان میتوانند به دزد افکار ما تبدیل شوند

حق کپی © ۲۰۰۱-۲۰۲۴ - Sarkhat.com - درباره سرخط - آرشیو اخبار - جدول لیگ برتر ایران